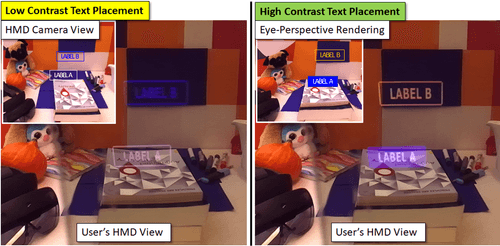

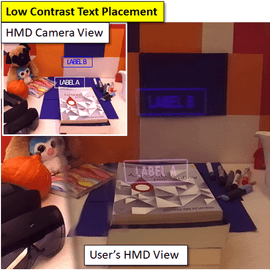

Durch die zunehmende Verfügbarkeit von tragbaren „optical see-through head-mounted displays” (z.B. Microsoft Hololens 2), also Datenbrillen mit lichtdurchlässigen, halbtransparenten Bildschirmen, wird Augmented Reality (AR) für den praktischen Einsatz in industriellen Anwendungen immer relevanter, in denen hilfreiche virtuelle Instruktionen über die reale Welt gelegt werden. Die lichtdurchlässigen Bildschirme der HMDs können das Umgebungslicht der realen Welt jedoch nicht blockieren. Dies führt dazu, dass sich die Bildschirmfarben mit den Hintergrundfarben der realen Welt vermischen, was zu geringem Kontrast und in weiterer Folge zu unverständlichen AR-Visualisierungen führt. Durch die inhärente Mobilität von OST HMDs ändert sich außerdem der Hintergrund für Visualisierungen kontinuierlich, was zu unvorhersehbaren visuellen Ergebnissen führt. Diese Visualisierungsprobleme sind im besten Fall nur limitierend, wenn NutzerInnen beispielsweise Instruktionen nicht wahrnehmen können. Weitaus gefährlicher sind jedoch Situationen, in denen Sicherheitsinstruktionen nicht sichtbar und verständlich sind und es zu falscher Handhabung von Maschinen und Ausrüstung kommt. Dieses Projekt ist ein erster Schritt zur Lösung dieser Probleme. Wir untersuchen neuartige adaptive Visualisierungen für AR, die die AR-Repräsentationen automatisch an die aktuellen Umgebungsbedingungen anpasst, um deren Verständlichkeit sicherzustellen.

Adaptive Visualisierung für Augmented Reality

Projektbeschreibung

Zusätzliche Information

Gefördert durch die Österreichischen Forschungsförderungsgesellschaft mbH (FFG) unter Projektnummer 877104

Projektpartner

Bilder

Publikationen

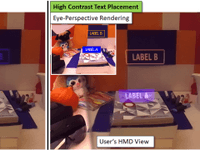

Towards Eye-Perspective Rendering for Optical See-Through Head-Mounted Displays (2022)

inproceeding

Eye-Perspective View Management for Optical See-Through Head-Mounted Displays (2023)

inproceeding